Сегодня в области искусственного интеллекта достаточно актуальны вопросы распознавания эмоций и эмоционального изменения голоса. В частности, эти технологии можно использовать в робототехнике, человеко-машинном взаимодействии, для голосового обучения, а также для определения физического состояния водителей. Ученые из Пермского Политеха предложили способ, который позволит роботам считывать эмоции людей и воспроизводить их в собственной речи. С помощью изменения интонации и ритма ученые создали эмоциональный голос. Результаты исследования они представили в журнале 2021 IEEE Conference of Russian Young Researchers in Electrical and Electronic Engineering (ElConRus).

По словам исследователей, эмоции – особый вид психических процессов, которые выражают то, что человек думает о своих отношениях с окружающей средой и самим собой. Способность испытывать их развивалась в процессе эволюции живых существ, помогая им более успешно адаптироваться к условиям жизни. Несмотря на то что люди выражают чувства по-разному, есть универсальные эмоции, которые понятны для представителей различных культур. Но одна из проблем распознавания эмоций и синтеза речи состоит в том, что нет их точной формализации: люди могут интерпретировать чувства других неоднозначно и нечетко.

– В последнее время появилось много способов распознавания эмоций, в том числе с помощью искусственных нейронных сетей. Но научить робота воспроизводить эмоциональную речь все еще достаточно сложно. Это многоэтапный процесс, который включает анализ человеческой речи и обнаружение эмоций во всех фразах, а затем синтез речи робота с необходимыми эмоциями. Каждый из этих шагов отличается высокой степенью неопределенности. Чтобы научить робота человеческому тону, тембру и эмоциям, мы предложили использовать прямое обучение по аналогии, – рассказывает один из разработчиков, магистрант кафедры «Автоматика и телемеханика» электротехнического факультета Пермского Политеха Ян Якубчик.

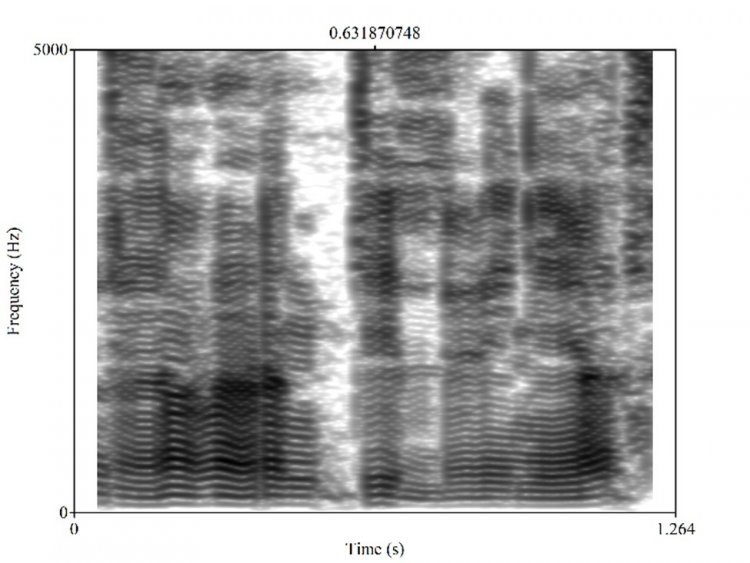

Спектрограмма результирующего звука

Разработчики обнаружили эмоциональный интонационный паттерн в речи и воссоздали его по той же фразе, произнесенной другим голосом. Из-за различий в говорении и эмоциях разных людей существует разница в скорости и ритме речи. По словам ученых, необходимо найти повторяющиеся звуки во фразах и сопоставить их, чтобы верно изменить высоту тона и ритм речи робота. Чтобы найти оптимальное соответствие между временными рядами, представляющими звуки, они использовали технику динамического преобразования времени.

Для оценки работы метода ученые провели эксперимент. С помощью студентов Пермского института культуры они записали 8 голосовых форматов эмоций и первый голос в спокойном тоне. Далее были разработаны матмодели эмоций голоса с помощью двух методов: наименьших квадратов и кепстральных коэффициентов. Таким образом удалось синтезировать измененные голоса.

– Чтобы добавить эмоции к полученному голосу робота, мы использовали третий метод – прямое обучение. Неэмоциональная фраза корректируется с помощью матмодели эмоций. Метод позволяет изменять интонацию фразы, оставляя текст прежним, – поясняет научный руководитель разработчика, доцент кафедры автоматики и телемеханики Пермского Политеха, кандидат технических наук Юрий Липин.

Алгоритм позволил создать несколько фраз, которые звучали достаточно естественно. В дальнейших планах разработчиков – создание языковой модели для распознавания и воссоздания эмоций, так как изменение речи в зависимости от эмоций во многом зависит от языка.

Источник информации и фото: пресс-служба Пермского Политеха