Технологии искусственного интеллекта всё прочнее встраиваются в нашу жизнь. Хорошо это или плохо? Нужны ли будут учёные, если искусственный интеллект станет более "умным"? Какие риски появляются у человека? На заседании Президиума РАН 23 ноября академик РАН Арутюн Аветисян выступил с докладом «Кибербезопасность в контексте искусственного интеллекта».

Тема искусственного интеллекта не всегда была так востребована, а в силу того, что не всегда можно было получить практические результаты, иногда и вовсе были "зимы", когда интерес к этому у учёных и у общественности "засыпал". Сейчас же, за последние 10 лет, этот интерес опять появляется, эти технологии внедряются практически во все отрасли экономики, а их неиспользование чревато экономическим отставанием.

«Мы живём в мире, когда взламывают наши системы, воруют наши данные, но мы всё равно это используем. Нужно научиться жить в этом мире, быть сильными, а не пытаться отгородиться и говорить, что "мы теперь в бункере, поэтому нам безопасно". Так не получится. Собственно, Академия наук, мне кажется, и есть та организация, которая должна это возглавить и вести», - говорит академик РАН Арутюн Аветисян в поддержку использования технологий искусственного интеллекта, несмотря на имеющиеся риски кибербезопасности.

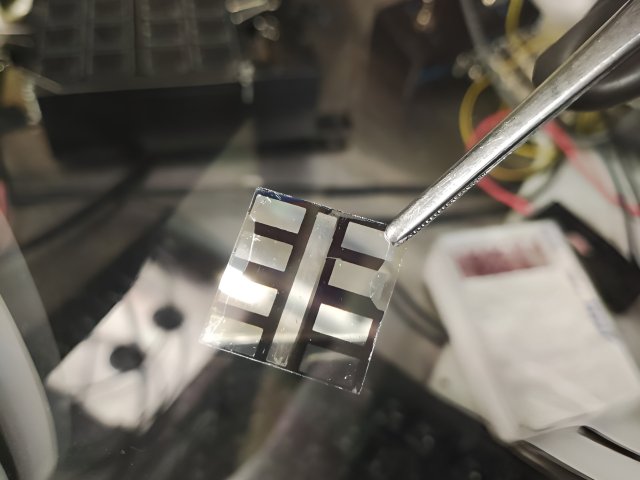

"Что касается самого искусственного интеллекта, к сожалению, с точки зрения математики, последние достижения - это, скорее, "грубая сила", большие данные и суперкомпьютерные мощности. Математика там достаточно простая. Любой математик, который этим занимается, может это сказать. Но внутри этого активно продолжаются исследования, придумываются новые подходы с целью того, чтобы усилить математическую составляющую и получить ещё бОльший конкурентный успех", - говорит Арутюн Аветисян.

"Даже если данные собирали только вы, никто их не видел, если они не полны, не точны и много чего другого, они сами по себе среда для того, чтобы хакер или внешний злоумышленник, не важно, как мы будем его называть, понимая это, смог сгенерировать атаку. Она может туда попасть и на уровне обучения, они могут попасть в уже готовую модель, если злоумышленник имеет к ней доступ. Это тоже очень важно. Нельзя создать «серебряную пулю». Если мы получили модель, не важно, какая она, мы её не защитим - это невозможно, как в случае обычного программного обеспечения, собственно говоря, кибербезопасность как научное направление поэтому и возникла".